Fabric Data Factory: Die nächste Generation der Datenintegration für Unternehmen

Die Ailio GmbH begleitet Unternehmen seit Jahren auf ihrem Weg zu effizientem Datenmanagement und Künstlicher Intelligenz. Mit den technologischen Neuerungen rund um Microsoft Fabric und vor allem Fabric Data Factory eröffnen sich für Data-Science- und Data-Engineering-Teams vollkommen neue Chancen. In diesem umfangreichen Blogartikel zeigen wir die wichtigsten Faktoren, die für die Umstellung auf Fabric Data Factory sprechen, und geben einen tiefen Einblick, wie die Plattform die Herausforderungen moderner Datenintegration adressiert – aus der Sicht von Entscheidungsträgern, Dateningenieuren und Fachexperten im B2B-Umfeld.

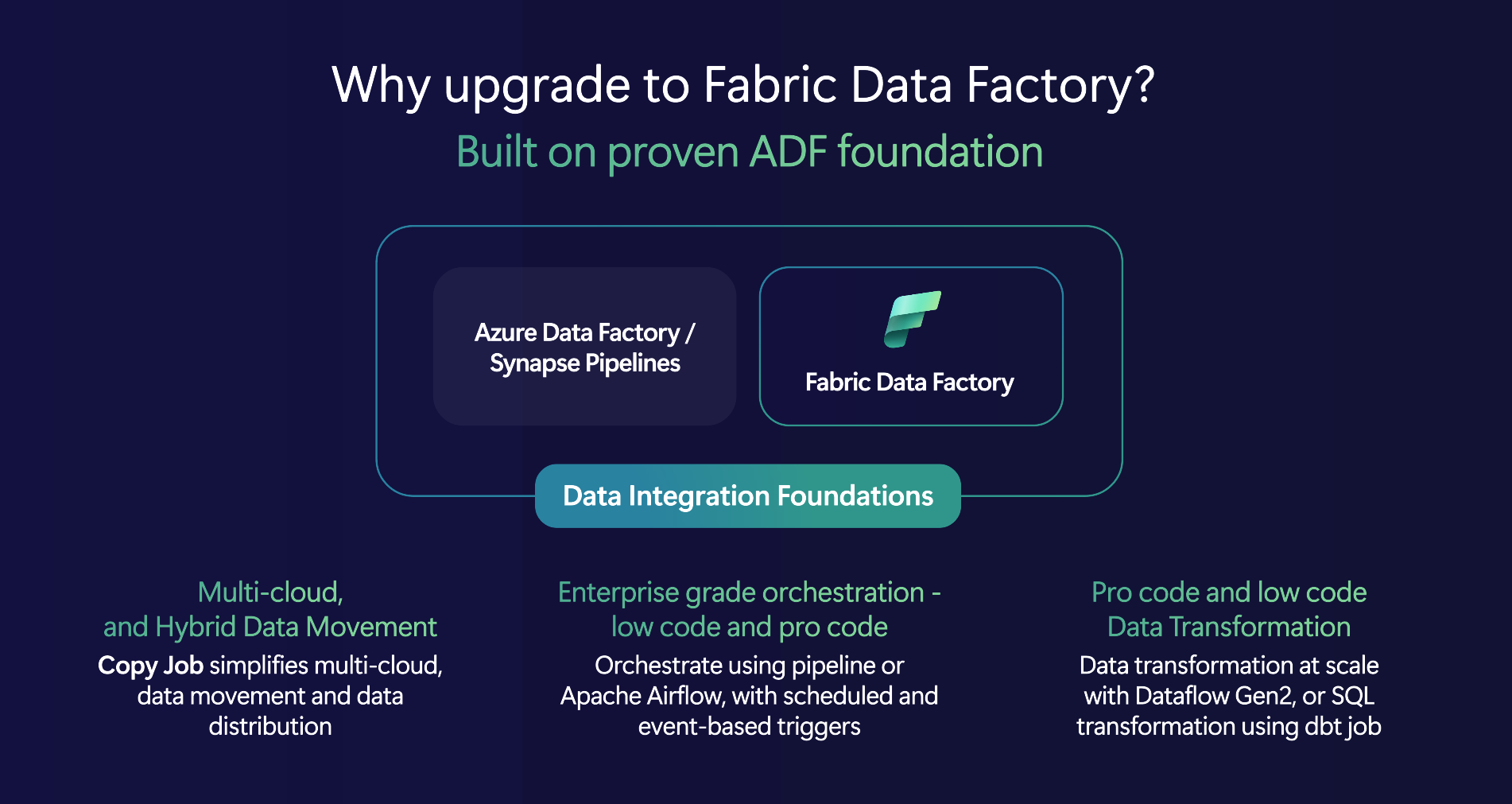

Warum sollten Unternehmen von Azure Data Factory zu Fabric Data Factory wechseln?

Bislang war Azure Data Factory (ADF) für viele Unternehmen der Standard für Datenintegration in der Cloud. Diese Lösung ist bewährt, leistungsstark und zuverlässig – doch Microsoft investiert sämtliche Innovationen künftig in die Fabric Data Factory. Das bedeutet: Wer auf dem aktuellen Stand der Technik bleiben will und von neuen Features wie KI-gestützter Entwicklung oder fortschrittlicher Orchestrierung profitieren möchte, sollte mittelfristig über den Umstieg nachdenken.

Spannend: Die Migration ist keine radikale Ablösung, sondern ein evolutionärer Schritt. Ihre bestehenden Pipelines, Konnektoren und Betriebsmodelle funktionieren weiterhin – Sie profitieren aber von einer Vielzahl moderner Erweiterungen (z.B. Copilot, Mirroring, Copy Jobs, Airflow, dbt-Integration), die bislang nicht zur Verfügung standen.

Verlässlichkeit und Enterprise-Tauglichkeit

Ein zentraler Anspruch im Enterprise-Umfeld ist die Stabilität und Skalierbarkeit der Datenplattform. Fabric Data Factory setzt hier auf die bewährte technische Grundlage von ADF: derselbe Connector-Katalog, dieselbe Ausführungslogik und die hohe Zuverlässigkeit, die Unternehmen heute im Produktionsumfeld erwarten. Gleichzeitig hebt Fabric Data Factory die Datenintegration auf ein neues Level durch moderne SaaS-Erfahrungen, einheitliche Governance, Security-by-Design und KI-Unterstützung.

Innovative Funktionen und Vorteile im Überblick

- Mirroring: Kontinuierliche, latenzarme Replikation von operativen Datenbanken und Cloud-Warehouses (z.B. SQL Server, Snowflake, Google BigQuery, Cosmos DB) direkt nach OneLake – ohne selbständig Pipelines entwickeln zu müssen. Bis zu einem bestimmten Limit ist das Computing und Storage hierfür sogar kostenlos. Gerade wer aktuell hohe Aufwände für kontinuierliche Datenbewegung in ADF betreibt, spart hier deutlich Ressourcen.

- Copy Jobs: Für Massenkopien, inkrementelle Synchronisation (via Watermarks) oder Change Data Capture (CDC, inkl. SCD Type 2 für Echtzeit-Historisierung) reichen wenige Konfigurationen – der Engineering-Aufwand sinkt drastisch.

- SAP-Integration: Dank strategischer Partnerschaft mit SAP stehen nativen, Konfigurations-basierten Schnittstellen für die Integration von Business Data Cloud-Daten aus der SAP-Welt zur Verfügung. Unternehmen können SAP-Daten mit minimalem Aufwand analytics-ready machen – und müssen weder eigene Ingestionspipelines noch Staging-Umgebungen bauen.

- Breite Konnektivität: Fabric Data Factory bietet schon jetzt die umfassendste Auswahl an Datenquellen und -zielen, darunter Snowflake, Oracle, Google BigQuery, Amazon S3 oder Databricks. Daten können flexibel an den Bestimmungsort übertragen werden, selbst wenn dieser außerhalb der Fabric-Landschaft liegt.

- OneLake Shortcuts: Direkter Datenzugriff auf bereits existente Speicherorte in Azure, AWS oder Google Cloud, ohne dass ein physischer Kopiervorgang oder eigene Staging-Pipelines nötig wären. Die Rechteverwaltung ist zentralisiert, Redundanzen und Overhead werden reduziert.

Von Batch zu Echtzeit: Datenintegration, die KI und Analytics beschleunigt

Typische Herausforderungen von klassischen Datenpipelines wie späte Ankunft von Daten, Out-of-order-Events oder Schemaänderungen führen in traditionellen Systemen zu komplexer, wartungsintensiver Logik. Mirroring und Copy Jobs automatisieren diese Prozesse und sorgen dafür, dass Daten immer aktuell, vollständig und historisch exakt für Analytics und KI-Anwendungen bereitgestellt werden. Das garantiert Transparenz und Effizienz – zwei kritische Voraussetzungen für „Industrial AI“ und moderne Data-Science-Workflows.

Künstliche Intelligenz & Low-Code: Data Factory Copilot und Dataflows Gen2

- Kodierung mit KI-Unterstützung: Der Copilot ist direkt in die Entwicklung integriert, unterstützt bei der Erzeugung von Pipelines, Dataflows und Transformationen durch natürliche Spracheingaben oder Dialoge.

- Low-Code/No-Code für Citizen Developer: Mit Mirroring und Copy Jobs sind viele Datenbewegungsaufgaben rein konfigurationsgetrieben. Dataflows Gen2, basierend auf Power Query (bekannt aus Excel/Power BI), bietet über 300 Transformationen und unterstützt zahlreiche Datenquellen – ganz ohne Programmierung, aber mit echten CI/CD- und Multiproduktionsfähigkeiten durch Variablen-Management und Umweltpromotion.

Advanced Engineering: Airflow und dbt-Integration

- Apache Airflow-Jobs: Vollständig verwaltete Airflow-Umgebung als SaaS ohne eigenen Infrastruktur-Aufwand. Bestehende DAGs können übernommen werden – für komplexe, Python-basierte Workflows und Multi-Step-Orchestrierung. Monitoring und Security sind nativ integriert.

- dbt-Jobs: Datenmodellierung und Transformation über SQL direkt in Fabric mit voller Versionierung (git-integriert) und Umgebungsmanagement. Die dbt-Jobs greifen nahtlos auf Lakehouse und Data Warehouse zu, und sorgen so für Transparenz vom Entwicklungs- bis in den Produktionsprozess.

Die Verbindung all dieser Tools auf einer einzigen Plattform eröffnet neue Möglichkeiten für Teams mit unterschiedlichen Schwerpunkten – von Citizen Integrators bis zu erfahrenen Data Engineers. Jedes Team kann bei minimaler Infrastruktur und maximaler Flexibilität auf seinen bevorzugten Technologiestack zurückgreifen.

Migration leicht gemacht – so gelingt der Wechsel von ADF auf Fabric

Der Wechsel zur Fabric Data Factory ist kein „Rip-and-Replace“. Microsoft bietet einen geführten, risikoarmen Migrationspfad: Im bestehenden Azure Data Factory-Authoring-Experience kann direkt ein Migrationsassistent gestartet werden. Dieser übernimmt die Zuordnung von Verbindungseinstellungen, prüft die Migration und erstellt einen nachvollziehbaren Plan – zu jedem Zeitpunkt haben Sie volle Kontrolle.

Fazit: Warum Sie jetzt auf Fabric Data Factory umsteigen sollten

Fabric Data Factory ist keine simple Weiterentwicklung, sondern eine ganz neue Liga der Datenintegration: Basierend auf bewährter ADF-Technologie, aber mit viel größerem Funktionsumfang und Zukunftsperspektive. Unternehmen profitieren von vereinfachtem Engineering, gesenkten Kosten, einer „AI-Ready“-Plattform sowie Transparenz und Governance im modernen SaaS-Betrieb. Wer Industrial AI, hybride Szenarien und Datengetriebene Innovationen vorantreiben möchte, hat mit Fabric Data Factory das ideale Fundament.

Die Ailio GmbH unterstützt Sie dabei mit tiefgreifender Expertise, pragmatischen Migrationsstrategien und Best Practices aus vielen internationalen Projekten – damit der Sprung in die neue Fabric-Welt für Sie zum Business-Vorteil wird.